Qu'est-ce que la computer vision et pourquoi l'utiliser ?

La computer vision, ou vision par ordinateur en français, est une branche de l’intelligence artificielle qui apprend aux machines à interpréter et à agir à partir de données visuelles.

C’est l’une des technologies les plus influentes de notre époque, utilisée aussi bien pour détecter des anomalies sur des images médicales que pour permettre aux voitures de rouler de manière autonome.

Cet article retrace cette évolution.

Nous revenons sur l'histoire de l'IA visuelle, l'essor du machine learning, la révolution du deep learning et les applications actuelles de la vision par ordinateur avant d’explorer les perspectives de cette technologie.

Premières tentatives pour apprendre aux ordinateurs à « voir » des formes simples.

La vision par ordinateur est née à la même époque que les premiers travaux sur l’intelligence artificielle. Alan Turing avait déjà posé la grande question :

Si les humains peuvent penser et voir, les machines pourraient-elles apprendre à faire de même ?

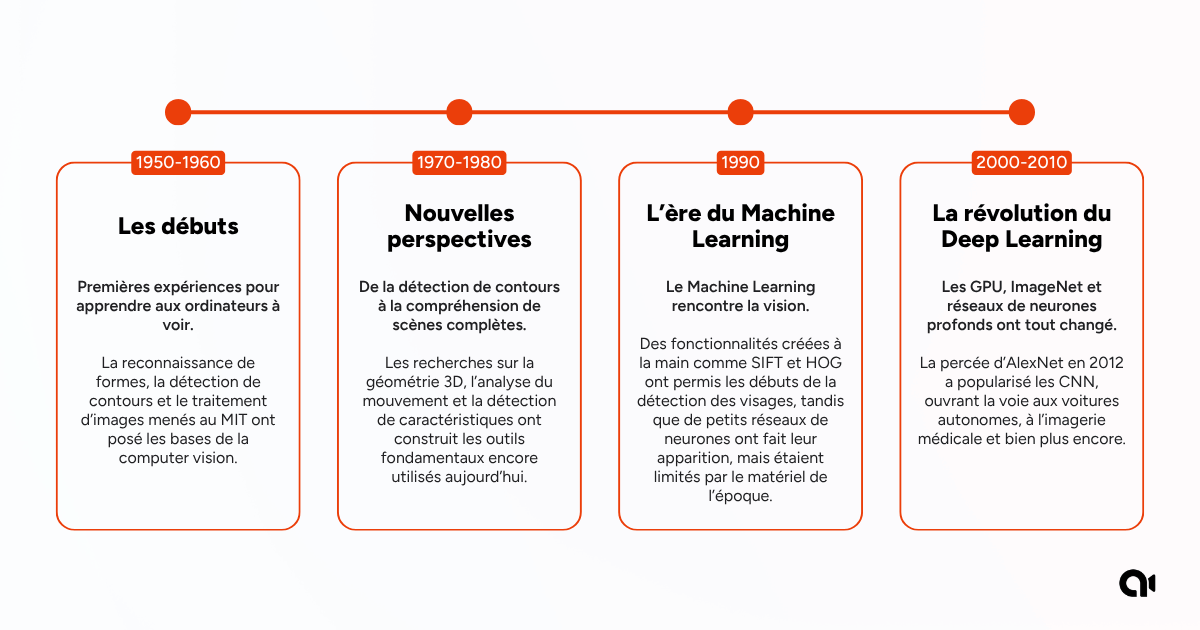

Dans les années 1950 et 1960, les chercheurs se sont penchés sur cette question en menant les toutes premières expériences sur la vision.

Les résultats étaient simples, mais révolutionnaires pour l'époque. Les premiers systèmes pouvaient détecter des formes basiques ou reconnaître des motifs dans des images en noir et blanc.

Au Massachusetts Institute of Technology (MIT), les chercheurs sont allés plus loin avec certaines des premières expériences de traitement d’image. Le célèbre Summer Vision Project (1966) visait même à faire en sorte qu'un ordinateur décrive ce qu'il voyait dans une scène, un objectif ambitieux à l'époque.

Des techniques comme la détection de contours (identifier où un objet se termine et où un autre commence) ou la reconnaissance d’objets de base ont montré que les ordinateurs pouvaient interpréter des informations visuelles.

Ces étapes expérimentales ont jeté les bases de ce qui allait devenir plus tard un domaine très vaste.

Dans les années 70, le sujet est passé de simples expériences hypothétiques à des objectifs plus concrets. Au lieu de se contenter de repérer des contours, les chercheurs voulaient que les ordinateurs comprennent des scènes entières.

Un système pouvait-il faire la distinction entre une personne marchant dans la rue et une voiture passant à côté ?

Cette question a stimulé les travaux sur la géométrie tridimensionnelle (3D), l'analyse du mouvement et la reconstruction d'environnements à partir de plusieurs images.

La détection de caractéristiques, c'est-à-dire l’identification et le suivi de points significatifs dans une image, a aussi marqué une avancée majeure. Elle est devenue la base de la détection d’objets et de la correspondance d’images.

La technologie était encore trop récente pour être utilisée au quotidien. Mais les outils développés à cette époque forment la base de la computer vision moderne.

Dans les années 90, la vision par ordinateur a commencé à s'inspirer de l'apprentissage automatique. Au lieu de coder toutes les règles possibles, les chercheurs ont appris aux ordinateurs à reconnaître des modèles à partir de données.

Des fonctionnalités conçues manuellement comme SIFT (Scale-Invariant Feature Transform) et HOG (Histogram of Oriented Gradients) sont devenues la norme.

Ces méthodes ont aidé les ordinateurs à reconnaître des objets même lorsque l'éclairage, l'angle ou la taille changeaient, ce qui a permis aux premiers logiciels comme les systèmes de détection de visages de voir le jour.

Les réseaux de neurones ont également fait leur apparition à cette époque. Ils suscitaient beaucoup d’intérêt, mais restaient limités par le matériel et les ensembles de données de l'époque. Il était possible de construire de petits modèles, mais leur mise à l'échelle n'était pas encore réaliste.

Cette période du XXe siècle a semé les graines de l'essor du deep learning qui a suivi.

Les avancées dans le domaine des GPU, des ensembles de données et des réseaux neuronaux profonds ont ouvert la voie à la computer vision.

Au début des années 2000, tout a changé. Les processeurs graphiques (GPU), initialement conçus pour les jeux vidéo, ont soudainement donné aux chercheurs la possibilité d'entraîner des modèles beaucoup plus volumineux.

Dans le même temps, de vastes jeux de données annotés comme ImageNet ont fourni à ces modèles les données dont ils avaient besoin pour vraiment apprendre.

C'est à ce moment-là que les réseaux de neurones convolutifs (CNN) sont entrés en scène. La percée a eu lieu en 2012 avec AlexNet, un CNN qui a écrasé la concurrence d'ImageNet et réduit considérablement les taux d'erreur.

Ce résultat a choqué la communauté des chercheurs et est souvent considéré comme le tournant de l'IA moderne.

Quelques personnalités clés ont contribué à rendre cette révolution possible :

Voici Yann LeCun présentant le premier réseau neuronal au monde en 1993 :

Le travail de ces personnalités a ouvert la voie à des applications concrètes que nous considérons aujourd’hui comme évidentes : de l'imagerie médicale aux voitures autonomes, en passant par les filtres Snapchat et la reconnaissance faciale.

La vision par ordinateur ou computer vision est une technologie fondamentale qui transforme encore aujourd'hui les industries et notre vie quotidienne.

Alors que le cerveau humain ne peut traiter qu'un nombre limité d'informations à la fois, les systèmes de vision par ordinateur peuvent analyser des milliers d'images par seconde, repérer des motifs invisibles à l'œil nu et fonctionner sans interruption ni fatigue.

Cette combinaison de précision et d'efficacité a ouvert la voie à des avancées révolutionnaires dans de nombreux domaines.

Prenons l'exemple du suivi des joueurs et du ballon dans le sport. Au basket-ball et au football, des systèmes basés sur des caméras comme SportVU suivent la position de chaque joueur et du ballon plusieurs fois par seconde, générant des données sur la vitesse, la distance parcourue, le positionnement et les interactions.

Voici un aperçu de son fonctionnement :

Ces données sont utilisées par les équipes pour analyser leurs tactiques, par les diffuseurs pour afficher des graphiques améliorés et par les fans pour voir des cartes thermiques, des trajectoires de déplacement et des mesures avancées.

Examinons de plus près d'autres domaines dans lesquels la vision par ordinateur a aujourd'hui un impact.

La computer vision est au cœur des voitures autonomes et des systèmes d'aide à la conduite (ADAS).

Ces systèmes automobiles alimentés par l'IA utilisent des caméras (souvent associées à des radars) pour percevoir le monde, détecter des objets, comprendre les voies de circulation, prédire les mouvements et éviter les collisions.

En permettant aux voitures de détecter en temps réel les piétons, cyclistes, panneaux de signalisation et autres véhicules, la computer vision améliore directement la sécurité routière.

En plus de prévenir les accidents, la vision par ordinateur rend la conduite plus efficace en aidant les véhicules à maintenir des distances de sécurité, à anticiper les changements de voie soudains et à s'adapter à des conditions difficiles, comme un mauvais éclairage ou des intempéries.

À plus grande échelle, l'autonomie promet de réduire les embouteillages, d'ouvrir la mobilité aux personnes qui ne peuvent pas conduire et, à terme, de transformer les environnements urbains actuellement dominés par les parkings et les infrastructures routières.

Voici quelques exemples concrets :

Voici un exemple du fonctionnement du Drive-thru Timer de Berry AI :

Des véhicules autonomes aux analyses opérationnelles dans les drives, la computer vision permet une compréhension en temps réel des environnements. Les systèmes prennent ainsi des décisions plus intelligentes, plus rapides et plus sûres.

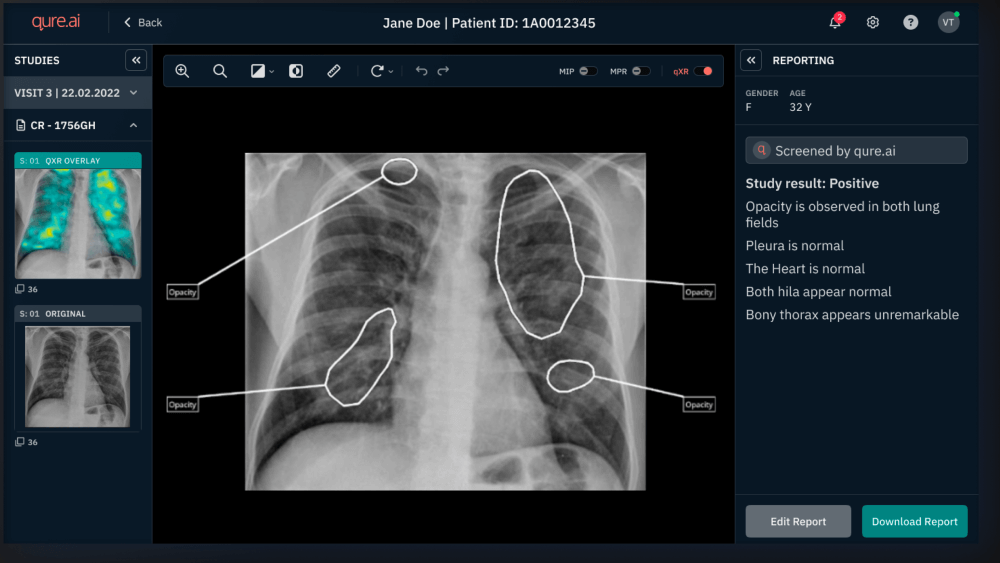

Dans un contexte où les données des patients augmentent plus rapidement que ce que les cliniciens peuvent traiter, la vision par ordinateur accélère le diagnostic, réduit les erreurs et aide à détecter les maladies plus tôt.

Le logiciel analyse d'énormes volumes de données médicales (radiographies, scanners, IRM) beaucoup plus rapidement que les humains, ce qui facilite la détection d'anomalies telles que les tumeurs, les fractures ou les structures cellulaires anormales.

Les systèmes de computer vision standardisent également le diagnostic, réduisant ainsi le risque d'erreurs humaines ou de variations entre les médecins. En prédisant l'évolution des maladies et en guidant les choix thérapeutiques, le logiciel favorise aussi des soins plus personnalisés.

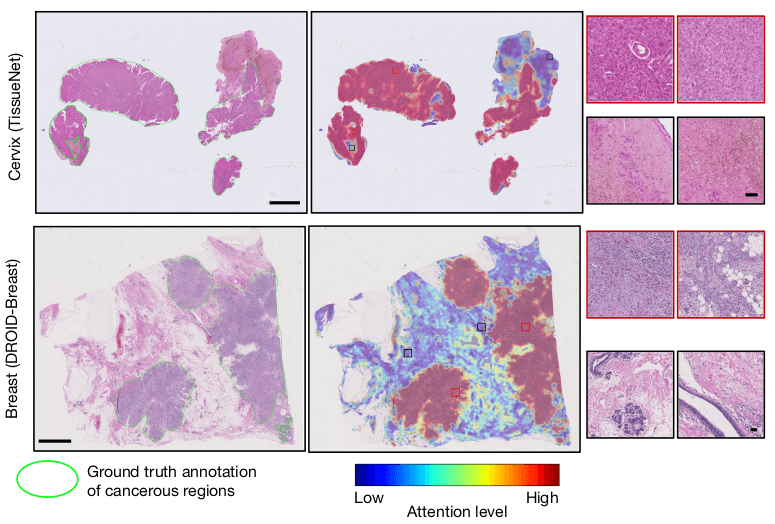

CHIEF (Clinical Histopathology Imaging Evaluation Foundation) est un bon exemple de la manière dont les programmes informatiques basés sur l'IA améliorent les soins de santé.

Entraîné sur des millions d'images, CHIEF est capable de détecter les cellules cancéreuses, de prédire les profils moléculaires des tumeurs, d'évaluer le microenvironnement tumoral et d'estimer la survie des patients. Le logiciel a surpassé de nombreux modèles existants sur plusieurs types de cancer.

Voici un exemple du fonctionnement de CHIEF :

Au-delà du diagnostic, la vision par ordinateur transforme également la robotique médicale.

Les systèmes de chirurgie robotique utilisent la reconnaissance d'images en temps réel pour améliorer la précision lors d'interventions complexes, permettant ainsi aux chirurgiens d'opérer avec des incisions plus petites et un risque réduit.

Les robots d'assistance guidés par vision aident également à surveiller les patients, à administrer des médicaments ou à soutenir la rééducation.

En fin de compte, la computer vision allège la charge de travail du personnel médical surchargé tout en améliorant la qualité des soins prodigués aux patients.

Alors que nos vies se déroulent de plus en plus en ligne et dans des systèmes numériques, il est essentiel de disposer d'un moyen sûr et fiable de vérifier l'identité des personnes.

La biométrie basée sur la vision offre un équilibre entre praticité et sécurité que les méthodes traditionnelles (comme les mots de passe ou les clés physiques) ne peuvent égaler.

En reconnaissant des caractéristiques uniques telles que le visage, les empreintes digitales ou l'iris, elle rend l’usurpation d’identité plus difficile et contribue à sécuriser les espaces sensibles, des smartphones aux points de contrôle aux frontières.

Au-delà de l'authentification, les systèmes d'IA visuelle améliorent la surveillance, aident les forces de l'ordre à localiser des personnes disparues ou des suspects, et permettent un contrôle d'accès plus fluide et plus sûr dans les aéroports, les lieux de travail et les installations hautement sécurisées.

Une plateforme récente de reconnaissance de l'iris développée par Fingerprint Cards permet d'identifier des personnes à de longues distances (approche « d'un simple coup d'œil »). Le logiciel présente un taux de fausses acceptations très faible (un sur un million).

Si ces systèmes experts offrent des avantages clairs, ils soulèvent également des défis importants et nécessitent des ajustements. Les préoccupations en matière de confidentialité, les biais algorithmiques et les erreurs telles que les fausses correspondances peuvent avoir de graves conséquences lorsqu'ils sont appliqués à grande échelle.

Les questions relatives au consentement, au stockage sécurisé des données et aux cadres légaux continuent d'alimenter le débat sur la manière dont la biométrie devrait être utilisée de manière responsable pour la sécurité de tous. Nous explorerons les applications éthiques futures de la vision par ordinateur dans la prochaine section.

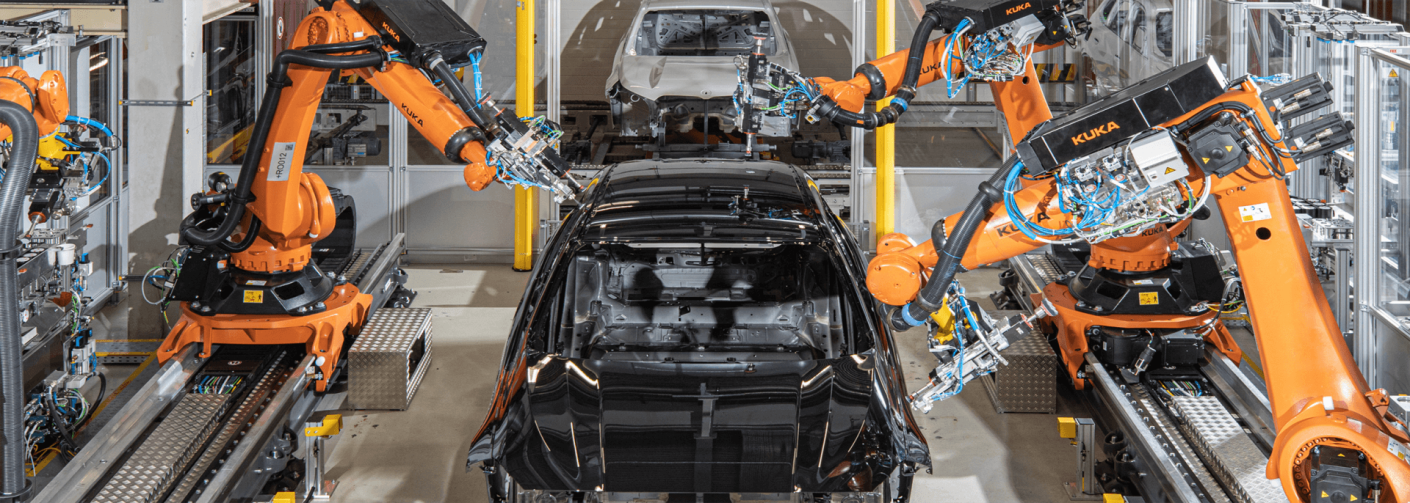

La fabrication moderne et la logistique reposent sur la rapidité, la flexibilité et la qualité. La vision par ordinateur permet aux robots de manipuler des produits de différentes formes et orientations, ce qui réduit le besoin d'outils rigides et coûteux.

Ces fonctionnalités rendent les usines plus adaptables aux changements dans la conception des produits ou la demande des clients. Dans le même temps, les systèmes d'inspection basés sur la vision détectent les défauts à un stade précoce, améliorant ainsi le contrôle qualité et réduisant les déchets.

Voici quelques exemples concrets :

Le constructeur automobile BMW (comme de nombreuses autres marques) utilise des robots pour l’assemblage et l’inspection automatisés — ce qu’ils appellent le traitement de surface automatisé.

En alliant précision et adaptabilité, la robotique industrielle basée sur la vision augmente la productivité, réduit les coûts et rend les chaînes d'approvisionnement mondiales plus résilientes.

La computer vision a beaucoup évolué depuis la simple détection des contours dans des images floues. Aujourd'hui, elle permet de piloter des voitures, de diagnostiquer des maladies et de sécuriser les identités.

La prochaine vague d'innovation consistera à combiner la vision avec d'autres capacités de l'IA, à aborder les questions éthiques et à intégrer des systèmes de vision dans des environnements quotidiens tels que les villes, les écoles et les lieux de travail.

Avant d’explorer les avancées futures, voici un aperçu rapide des bonnes pratiques en matière de computer vision que nous détaillerons ci-dessous :

| Domaine | Bonne pratique |

|---|---|

| Gouvernance |

Définir des politiques claires en matière d'IA, des cadres de consentement et des mesures de responsabilité pour les déploiements de vision par ordinateur.

Pourquoi c’est important : Garantit une utilisation responsable, renforce la confiance des utilisateurs et s'aligne sur les réglementations telles que la loi européenne sur l'IA. |

| Éthique |

Vérifier l'absence de biais dans les ensembles de données, garantir la diversité et mettre en œuvre des méthodes préservant la confidentialité.

Pourquoi c’est important : Réduit les conséquences néfastes, évite les résultats discriminatoires, protège les données sensibles et favorise une IA équitable et fiable. |

| Opérations |

Surveiller en continu les modèles, les réentraîner avec des données mises à jour et intégrer l'IA multimodale de manière responsable.

Pourquoi c’est important : Maintient des performances fiables malgré l'évolution des conditions réelles, garantit des interactions visuelles et linguistiques précises et prend en charge des applications allant de la réalité augmentée/virtuelle aux villes intelligentes. |

| Environnement |

Optimiser l'efficacité des algorithmes, utiliser des centres de données plus écologiques et suivre l'impact environnemental.

Pourquoi c’est important : Minimise la consommation d'énergie et de ressources, rendant l'IA durable tout en alimentant des applications de vision à grande échelle comme les véhicules autonomes et la surveillance urbaine. |

Ces bonnes pratiques constituent une base solide pour comprendre les futures orientations et applications de la vision par ordinateur.

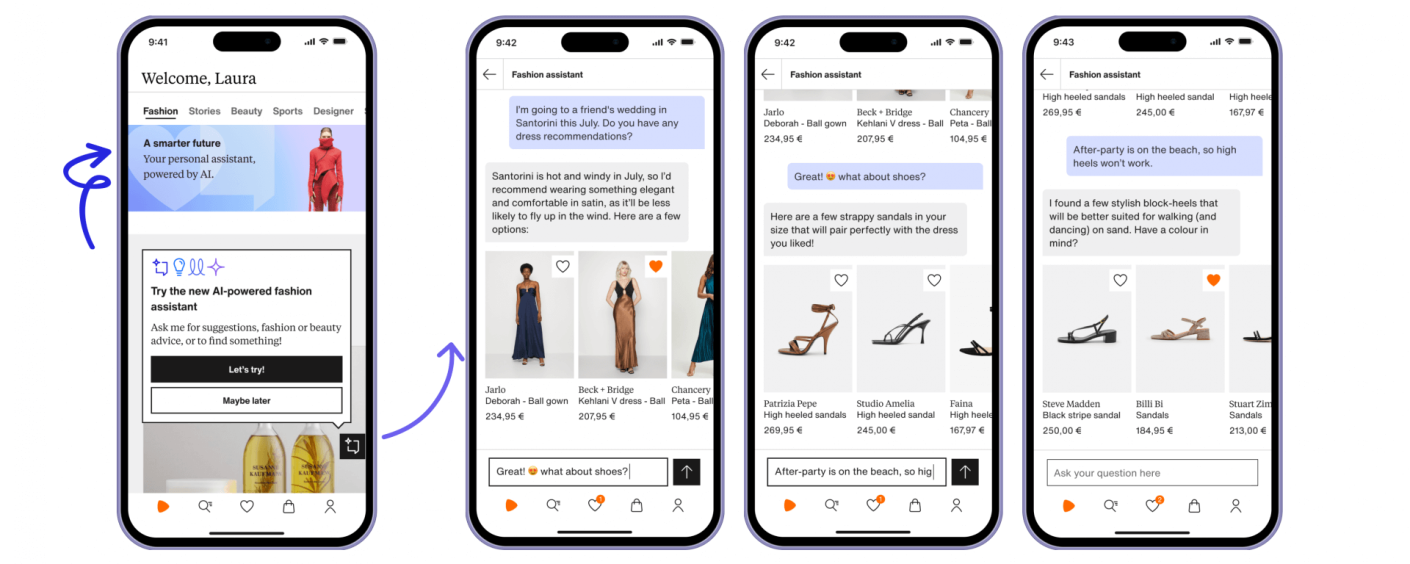

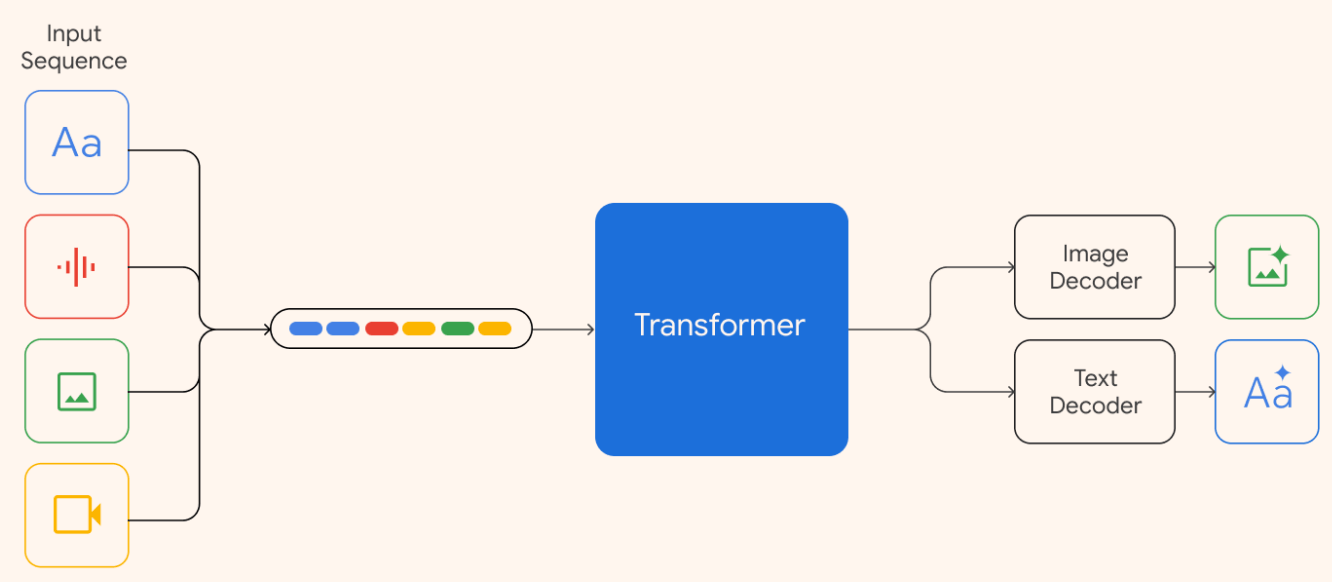

En associant la vision par ordinateur au traitement du langage naturel (NLP), les machines peuvent relier ce qu'elles voient à ce que nous disons ou écrivons. Ce processus est connu sous le nom d'IA multimodale.

Remarque : l'IA multimodale peut comprendre et combiner des informations provenant de différents types de données (images, texte et audio, par exemple) pour effectuer des tâches de vision par ordinateur ou répondre à des questions de façon plus pertinente. La combinaison de ces systèmes rend l'IA plus naturelle et plus utile.

Imaginez que vous pointez l'appareil photo de votre téléphone vers un plat dans un restaurant et vous obtenez instantanément la recette. Ou que vous prenez une photo d'un produit et demandez à un assistant IA de comparer les prix, les avis et d'obtenir des recommandations personnalisées :

Des modèles comme ChatGPT-5 avec vision d'OpenAI et Gemini de Google favorisent cette intégration, permettant des interactions plus riches et qui semblent plus humaines.

Voici comment Gemini procède :

À mesure que cette technologie se développe, nous assisterons à des parcours clients plus fluides, à une recherche d’information plus rapide et à des expériences digitales plus personnalisées.

La propagation rapide de la computer vision a suscité de grands débats. Comment s'assurer que ces systèmes sont équitables, respectueux de la vie privée et fiables ?

Les inquiétudes autour des biais dans la reconnaissance faciale, de la surveillance intrusive et de la mauvaise gestion des données sont bien réelles.

Joy Buolamwini, fondatrice de l'Algorithmic Justice League, parle des biais de l’IA dans la reconnaissance faciale :

Je regardais les ensembles de données et je les parcourais pour compter : combien de personnes à la peau claire ? Combien à la peau foncée ? Combien de femmes, combien d'hommes, etc. Et certains des ensembles de données vraiment importants dans notre domaine pouvaient compter 70% d'hommes et plus de 80% de personnes à la peau claire. Et ce type d'ensembles de données pouvait être considéré comme la norme de référence.

Nous comprenons que ces préoccupations sont réelles, mais il existe de nombreux aspects positifs et des systèmes qui fonctionnent correctement et de manière éthique. Les innovateurs et les régulateurs travaillent à trouver des solutions plutôt que d'ignorer les problèmes.

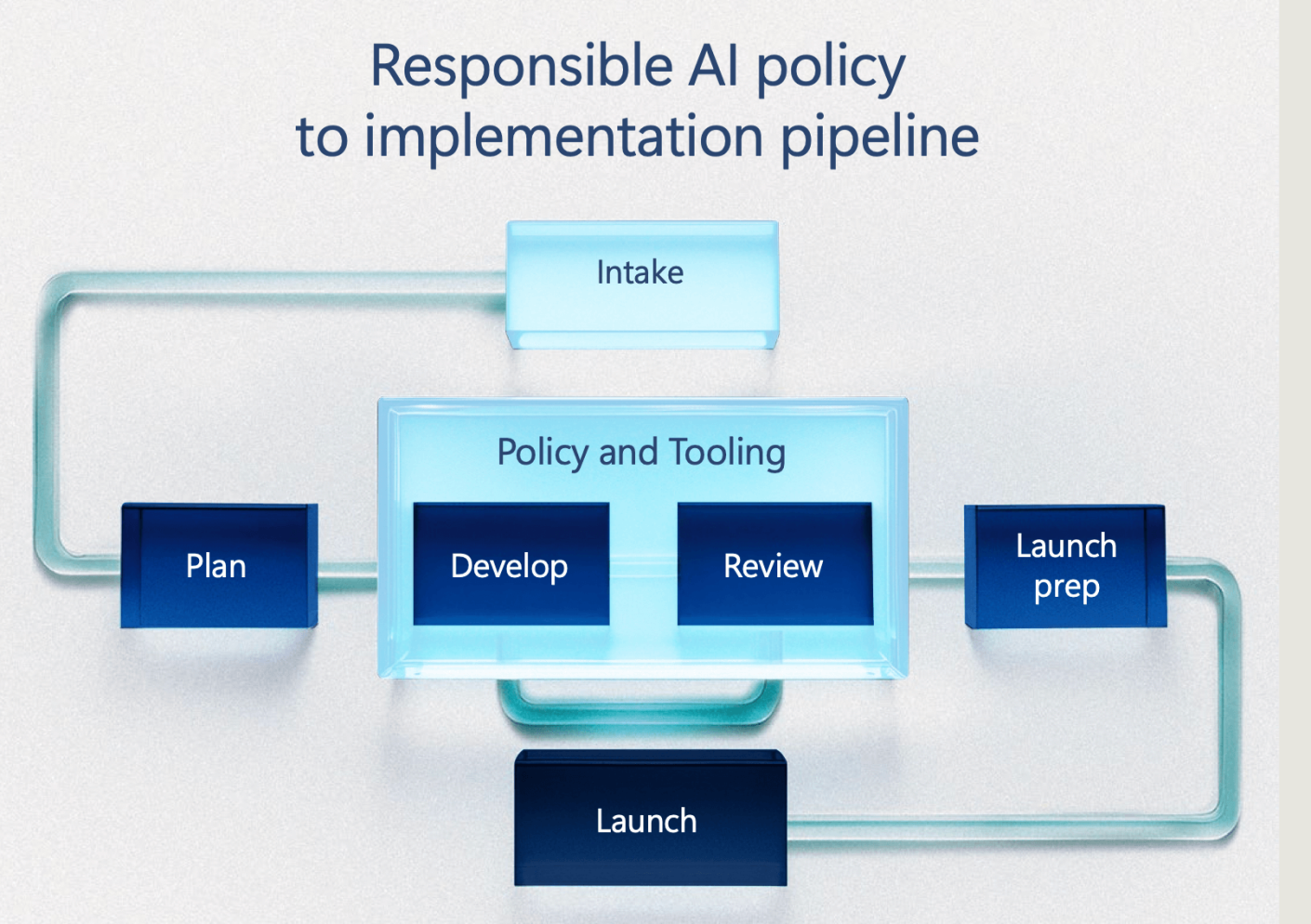

La confiance est essentielle pour que la vision par ordinateur soit largement acceptée, c'est pourquoi les entreprises intègrent dès le départ des mesures de protection dans leurs systèmes afin de rassurer les utilisateurs et le grand public.

Par exemple, les organisations améliorent la qualité des données en veillant à ce que les données d'entraînement soient diverses et représentatives afin d'éviter des résultats biaisés :

Les chercheurs du MIT ont mis au point une technique qui identifie et supprime les points de données qui provoquent des erreurs sur certains sous-groupes minoritaires, améliorant ainsi l'équité sans compromettre la précision.

Les institutions nationales et les chefs d'entreprise du monde entier jouent également un rôle important en matière de protection :

Voici un aperçu du processus de mise en œuvre de la politique IA de Microsoft visant à minimiser les risques :

Les recherches en cours élargissent les capacités de la vision par ordinateur au-delà de la détection pour permettre un raisonnement sur le monde visuel.

Des institutions comme l’Université de Princeton développent des systèmes combinants vision par ordinateur, apprentissage automatique, interaction homme-machine et sciences cognitives des données.

Elles se concentrent sur la manière dont l'IA peut :

Dans le même temps, elles accordent la priorité à l'équité, la responsabilité et la transparence. Ces recherches garantissent que les futurs systèmes de vision seront non seulement plus performants, mais aussi éthiques, équitables et adaptables à diverses populations.

Les préoccupations environnementales méritent également d'être soulignées.

Les centres de données qui alimentent l'IA consomment d'énormes quantités d'énergie et d'eau, dépendent de minéraux rares et génèrent des déchets électroniques. Toutes ces activités contribuent aux émissions de gaz à effet de serre et à l'épuisement des ressources, et des entreprises comme Google prennent déjà des mesures pour atténuer cet impact.

Le Programme des Nations Unies pour l’Environnement (UNEP) souligne la nécessité de mettre en place des pratiques durables en matière d'IA, notamment en mesurant l'empreinte environnementale, en améliorant l'efficacité des algorithmes, en rendant les centres de données plus écologiques et en intégrant les politiques d'IA dans des stratégies environnementales plus larges afin de garantir que les avantages de l'IA l'emportent sur ses coûts.

La computer vision offre des expériences totalement inédites dans les mondes physique et numérique. La réalité augmentée (RA) et la réalité virtuelle (RV) s'appuient largement sur la vision en temps réel pour suivre les mouvements, superposer des objets numériques et créer des environnements réalistes.

Les marques du retail utilisent déjà la RA pour permettre aux clients d'« essayer » des vêtements ou de visualiser des meubles dans leur salon :

Dans le domaine du divertissement, les casques VR combinés au suivi des mains par vision permettent des jeux plus immersifs et interactifs :

Au-delà des applications grand public, l'impact de la vision par ordinateur est énorme dans les infrastructures et la vie urbaine.

Les villes intelligentes, par exemple, utilisent des systèmes de vision pour surveiller le flux de circulation, réduire les embouteillages et améliorer la sécurité des piétons. En cas d'urgence, cette technologie permet de détecter les dangers ou d'indiquer les itinéraires d'évacuation.

Prenons l'exemple de Singapour. L’agence A*Star (Agency for Science, Technology and Research) a créé une flotte autonome pour aider les personnes âgées et en situation de handicap à rester mobiles.

Parallèlement, les étudiants de l'Université nationale de Singapour peuvent se déplacer sur le campus à bord d'une navette autonome :

Dans les domaines de la construction et de l'architecture, la vision combinée à la réalité virtuelle permet de créer des espaces virtuels précis avant même que la construction ne commence. Cette technologie permet de réaliser des économies et d'améliorer la collaboration entre les équipes à travers le monde.

Dans une étude de cas sur la réalité virtuelle dans la construction, Kyle E. Haggard, chef de projet chez DPR Construction, déclare :

[La réalité virtuelle] a le potentiel d'augmenter de manière exponentielle l'intégrité d'un projet en termes de temps, de coût et de qualité.

Grâce à la réalité virtuelle et à la modélisation basée sur la vision, les équipes de projet peuvent identifier les problèmes de conception, optimiser les workflows et coordonner plusieurs disciplines avant de lancer les travaux.

La technologie permet également aux clients de réaliser des visites immersives, ce qui les aide à visualiser le résultat final et à donner leur avis alors que les ajustements restent simples et peu coûteux.

La voie à suivre est claire : trouver un équilibre entre innovation et responsabilité, et la computer vision continuera à transformer la société de manière bénéfique pour tous.

Le titre de « père de la vision par ordinateur » fait parfois l'objet de débats.

Larry Roberts est souvent cité comme l’un des fondateurs, grâce à sa thèse révolutionnaire présentée au MIT en 1963 sur la détection d'objets en 3D par les machines.

Azriel Rosenfeld est également reconnu pour ses recherches pionnières dans le traitement d’images numériques, la reconnaissance des formes et les premiers algorithmes de computer vision dans les années 1960 et 1970. Ses travaux ont jeté les bases de l'analyse de l’analyse visuelle par les machines.

Kunihiko Fukushima est aussi salué pour avoir développé le Neocognitron à la fin des années 1970, un modèle précurseur de réseau neuronal artificiel qui anticipait les techniques modernes de deep learning appliquées à la vision.

Les trois R sont la reconnaissance, la reconstruction et la récupération :

Les débuts de la vision par ordinateur concernaient des tâches simples telles que la détection de contours, la reconnaissance de formes basiques et l'interprétation de motifs en noir et blanc. Les systèmes pouvaient extraire des caractéristiques et identifier des objets dans des environnements contrôlés, mais leur complexité était limitée.

Les recherches menées au MIT et dans d'autres institutions ont exploré la classification et le traitement d'images, la détection de motifs et la reconnaissance précoce d'objets, posant les bases des systèmes de vision modernes.

La vision par ordinateur a évolué, passant de la simple détection de contours sur des images floues à la conduite de voitures, au diagnostic médical et à l’interprétation du monde à grande échelle.

Ce n’est plus une expérience de laboratoire, mais une base essentielle pour des interactions plus intelligentes et des expériences client plus riches.

Chez Apizee, nous savons à quel point il est important de s'aligner sur les dernières tendances en matière d'IA. Nous suivons de près l’évolution de l'IA visuelle et exploitons judicieusement son potentiel pour renforcer l’efficacité et la qualité des expériences, sans compromettre le jugement humain.

Découvrez comment Apizee peut aider votre équipe à offrir un service client plus rapide, plus intelligent et plus personnalisé grâce à l’engagement visuel.

Demander une démoDécouvrez comment la carte d’empathie aide les équipes du service client à mieux comprendre les besoins, émotions et comportements des clients.

Comment la carte d’empathie améliore la compréhension du service client

7 avr. 2026

Découvrez comment le framework DIET aide les équipes du service client à clarifier les attentes, réduire les incompréhensions et améliorer la satisfaction client.

Comment le framework DIET améliore la communication du service client

31 mars 2026

Découvrez les top influenceurs de l'expérience client en Europe, qui façonnent l'avenir du CX et du service client.

Top Influenceurs Expérience Client à suivre

17 mars 2026

Nos solutions vous intéressent ?